Wat is de AI Act en wie krijgt ermee te maken?

Op woensdag 13 maart 2024 heeft het Europese Parlement met een grote meerderheid de AI Act aangenomen. Deze wet regelt de inzet van artificiële intelligentie (AI) in systemen. De AI Act is de eerste wet ter wereld die toeziet op het gebruiken en inzetten van AI.

Maar liefst 523 leden van het Europees Parlement stemden voor de wet. 46 leden stemden tegen, terwijl 49 leden zich onthielden van stemming. Daarmee is het draagvlak voor de wet groot. Er is wel lang onderhandeld over de definitieve wettekst. Vooral Frankrijk en Duitsland lagen dwars. Maar nu is hij er dan, een revolutionaire wet.

De 27 landen van de EU moeten de AI Act nog wel definitief goedkeuren, maar dat lijkt een formaliteit. Daarna wordt de wet (onmiddellijk) gepubliceerd. Zes maanden na het ingaan van de wet gaat deze dan gelden voor verboden AI-systemen. Na 24 maanden geldt de wet ook voor zogenaamde hoogrisicosystemen. Hieronder vallen HR- en recruitmentsystemen die gebruik maken van AI.

Hoge boetes

Het overtreden van de wet heeft grote consequenties. Variërend van de aard van de overtreding bedraagt de boete € 7,5 miljoen of 1,5% van de wereldwijde omzet tot € 35 miljoen of 7% van de wereldwijde omzet.

De AI Act

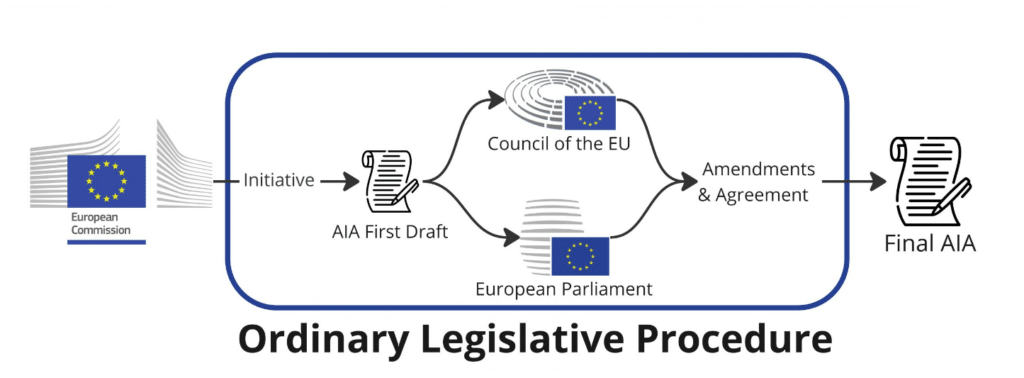

Aan de totstandkoming van de AI Act is lang gewerkt. Logisch gezien de complexiteit en de impact van het onderwerp.

Wie vallen onder de werking van de wet?

Vooral ontwikkelaars (aanbieders) van AI-systemen moeten aan diverse verplichtingen voldoen. Als je een AI-systeem in de EU op de markt brengt dat als een hoog risico-systeem wordt geclassificeerd moet je aan de wet voldoen. Dat geldt ook als je een dergelijk systeem in de EU op de markt brengt en niet in de EU gevestigd bent.

Voor gebruikers is de wet minder streng. Gebruikers zijn natuurlijke of rechtspersonen die een AI-systeem in een professionele setting inzetten. Dit betreft dus niet de eindgebruikers. Als je als uitzendorganisatie of recruitmentbureau een systeem inzet voor het matchen van sollicitanten met behulp van AI, dan ben je gebruiker.

Systemen ingedeeld naar risico

De AI Act deelt AI-systemen in naar risico. Zo zijn AI systemen die grote risico’s met zich mee brengen, bijvoorbeeld manipulatie, verboden. Daarnaast worden veel systemen als hoog risico-systeem geclassificeerd, bijvoorbeeld omdat het risico van discriminatie op de loer ligt. Hier hebben de meeste regels uit de wet betrekking op.

Dan zijn er nog systemen met een laag risicoprofiel. Hier gelden minimale regels voor. Aanbieders en gebruikers moeten ervoor zorgen dat eindgebruikers zich bewust zijn van het feit dat zij te maken hebben met een AI-systeem, bijvoorbeeld bij gebruik van chatbots of het produceren van deepfakes.

Als het risico minimaal is – dat geldt bijvoorbeeld voor videospelletjes met AI en spamfilters, dan gelden er geen regels.

Verboden gebruik van AI

De volgende typen AI-systemen zijn verboden volgens de AI-wet.

- Systemen die manipulatieve of misleidende technieken inzetten om gedrag te beïnvloeden

- Systemen die kwetsbaarheden gerelateerd aan leeftijd, handicap of sociaaleconomische omstandigheid uitbuiten

- Biometrische categorisatiesystemen die gevoelige kenmerken afleiden (ras, politieke meningen, vakbondslidmaatschap, religieuze of filosofische overtuigingen, seksleven of seksuele geaardheid

- Systemen die individuen of groepen classificeren op basis van gedrag of persoonlijke eigenschappen (social scoring)

- Systemen die databases samenstellen op basis van gezichtsherkenning door ongericht schrapen (‘scrapen’) van gezichtsbeelden van het internet

- Systemen die emoties afleiden van medewerkers of studenten op werkplekken of onderwijsinstellingen. Dit mag alleen als het om medische of veiligheidsredenen noodzakelijk is.

AI-systemen met hoog risico

Sommige systemen zijn niet verboden, maar brengen wel hoge risico’s met zich mee. Een voorbeeld is een recruitmentsysteem dat op basis van AI bepaalt of sollicitanten uitgenodigd worden voor een gesprek of een afwijzing ontvangen. Als de AI niet goed getraind is kan het systeem bijvoorbeeld onbewust discrimineren.

AI-systemen worden altijd beschouwd als hoog risico-systeem als het gaat om het profileren van individuen. Het gaat dan om het geautomatiseerd verwerken van persoonsgegevens om verschillende aspecten van iemands leven te beoordelen. Zoals bijvoorbeeld werkprestaties, economische situatie, gezondheid, voorkeuren, interesses, betrouwbaarheid of gedrag.

Er is een lijst (Annex 2) aan de AI Act toegevoegd om te bepalen of een systeem of product een hoogrisico AI-systeem is. Daarnaast is er een bijlage met gebruikscenario’s (use cases, Annex 3) om te verduidelijken welke producten en systemen als hoogrisico geclassificeerd worden. Twee daarvan hebben betrekking op HR en Recruitment:

Onderwijs en beroepsopleiding:

AI-systemen die toegang tot onderwijs- en beroepsopleidingsinstellingen. Het beoordelen van het geschikte onderwijsniveau voor een individu. Het evalueren van leerresultaten. Het monitoren en detecteren van verboden studentengedrag tijdens toetsen.

Recruitment en werkgelegenheid:

AI-systemen gebruikt voor werving of selectie, met name getargete vacatureadvertenties, het analyseren en filteren van sollicitaties en het beoordelen van kandidaten. Promotie en beëindiging van contracten, het toewijzen van taken op basis van persoonlijkheidskenmerken of -eigenschappen en gedrag. Het monitoren en evalueren van prestaties.

Steeds meer HR- en recruitmentsystemen zullen dus als risicovol worden beoordeeld, omdat ze aan bovenstaande use cases voldoen.

Er zijn verder nog use cases over onder andere kritieke infrastructuur, rechtshandhaving, migratie, asiel en grensbewaking, toegang tot essentiele publieke en private services en het vastleggen van democratische processen.

Tip! Lees ook: Wat is ChatGPT? Uitleg en kansne voor de recruitmentbranche

Eisen aanbieders AI-systemen hoog risico

Aanbieders van AI-systemen met hoog risico moeten volgens de AI Act aan strenge eisen voldoen:

- Ze moeten een risicobeheersysteem (risk management system) opzetten gedurende de levenscyclus van het AI-systeem

- Data governance uitvoeren, waarbij wordt gezorgd dat trainings-, validatie- en testdatasets relevant en voldoende representatief zijn

- Ze moeten technische documentatie opstellen om naleving aan te tonen

- Ze moeten gebruikers instrueren zodat deze compliant zijn

- Het systeem moet zodanig ontworpen zijn dat menselijk toezicht mogelijk is

- Er moet een kwaliteitsmanagementsysteem opgezet worden om naleving te borgen

- Er moet rekening gehouden worden met cybersecurity

AI Office

De EU wordt bij de invoering van de AI Act ondersteunt door het AI Office. Dit orgaan speelt een belangrijke rol bij de ondersteuning van de EU-lidstaten bij de implementatie van de wet. Ook kan het bureau sancties opleggen voor niet naleving van de wet of het nalaten van de invoering van de AI Act.